Nur der Hass zählt

Julia Ebner hat sich bei organisierten Trollen im Netz eingeschleust und ihre Strategien untersucht. Sie sind einfach – und fatal

fluter.de: Trollfabriken – das klingt nach Fantasy-Spiel und „Herr der Ringe“. Was ist ein Troll im Netz überhaupt?

Julia Ebner: Das ist ein Nutzer, der absichtlich versucht, durch seine Kommunikation im Netz Probleme zu machen. Ein Störenfried, oft auf Kosten von anderen. Meistens will er Konflikte schüren und Meinungen beeinflussen.

In den Kampagnen vor der US-Präsidentschaftswahl 2016 konnte man beobachten, dass Trolle zunehmend politische Ziele verfolgen.

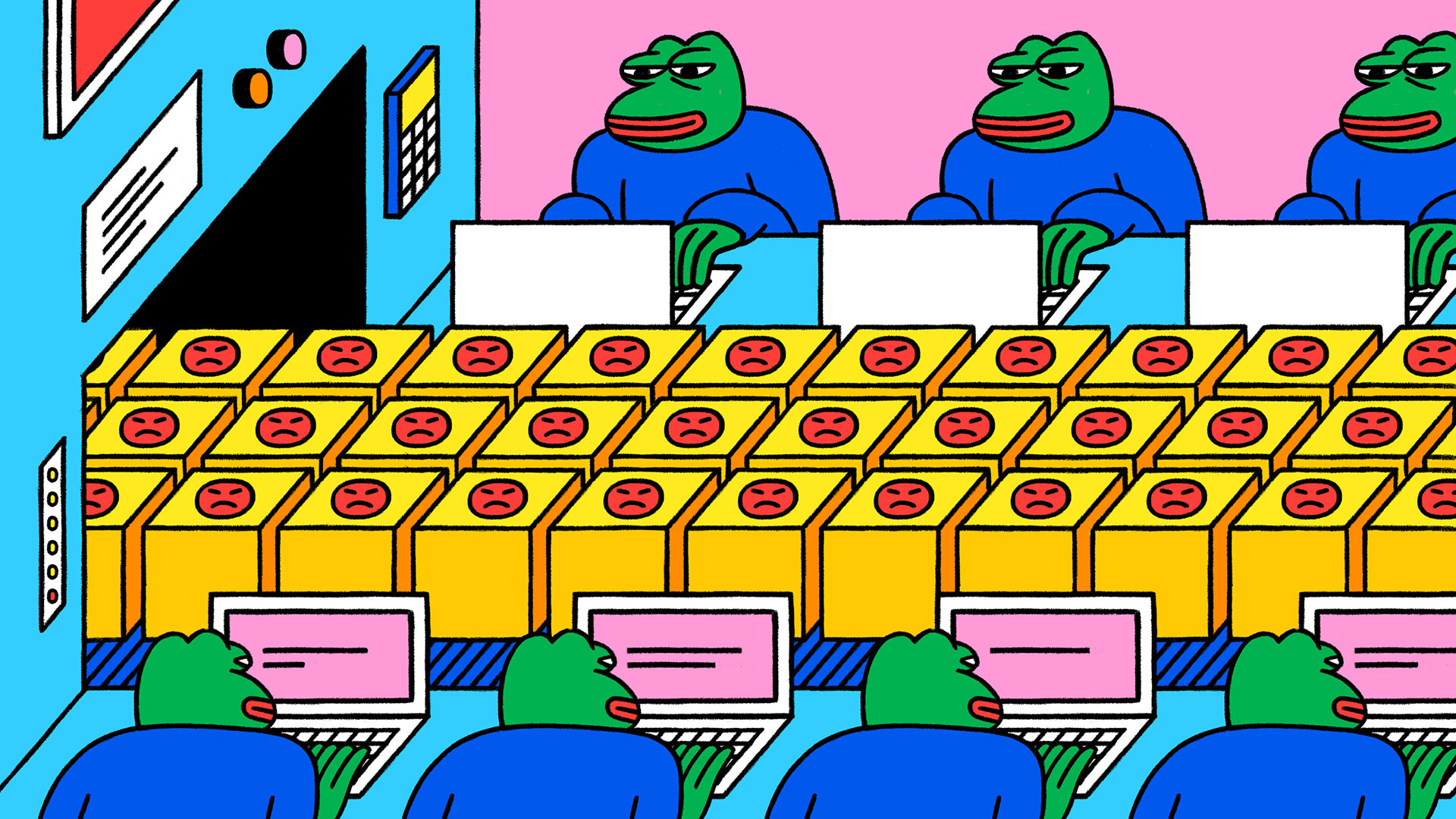

Zuvor haben Trolle tatsächlich oft „nur“ Streiche gespielt. Die Trump-Wahl ist ein Wendepunkt. Seitdem versuchen Trolle verstärkt, das Meinungsklima in den sozialen Netzwerken in eine bestimmte Richtung zu lenken. Reconquista Germanica, also Deutschlands größte Trollfabrik, und auch viele andere, vor allem rechtsextreme Trollcommunitys, die in Europa aktiv sind, haben sich das von den amerikanischen Trollen während der Pro-Trump-Kampagne 2015/2016 abgeschaut. Jetzt wenden sie dieses Know-how in den jeweiligen Ländern an.

„50 Prozent der Likes bei Hasskommentare gehen von nur 5 Prozent der Nutzer aus“

Wie arbeitet die Trollfabrik von Reconquista Germanica?

Sie ist eine rechtsextreme Trollarmee, die den politischen Diskurs in Deutschland zu beeinflussen versucht. Dazu startet sie gezielt Kampagnen zur Einschüchterung und Desinformation, um bei Facebook und Twitter einen möglichst großen Effekt zu erzielen. Kurz vor der Bundestagswahl 2017 hatte Reconquista Germanica 7.000 Mitglieder, vor der letzten Serversperrung im Juni 2018 waren es über 10.000 Mitglieder. Die Gruppe ist streng hierarchisch und nach militärischen Rängen gegliedert, die zum Teil Referenzen zum Nationalsozialismus aufweisen. Aber das ist nicht die einzige Gruppe, die es gibt. #Infokrieg ist wesentlich kleiner und gehört zum Netzwerk der sogenannten Identitären Bewegung, einer rechtsextremistischen Gruppierung, die die europäische Identität als durch Muslime und Migranten bedroht ansieht. Die Mitglieder beider Gruppen kommunizieren über Server der Online-Chat-App Discord.

Vor der Bundestagswahl 2017 haben Sie das Verhalten dieser beiden umstrittenen Gruppen analysiert und ausgewertet. Dazu haben Sie sich für mehrere Wochen in deren Netzwerke eingeschleust. Was haben Sie herausgefunden?

Das für mich überraschendste und auch besorgniserregendste Ergebnis war, wie stark koordiniert die Aktionen dieser Trollarmeen sind und welch massiven Effekt die Aktionen in den sozialen Netzwerken haben. Das hatte ich so nicht erwartet.

Welchen Effekt haben die Aktionen?

Das, was sie auf geheimen Plattformen planen, manifestiert sich tatsächlich in den Mainstream-Kanälen. Sie schaffen es, zuvor vereinbarte Hashtags zum Trenden zu bringen oder bestimmte Politiker, Journalisten und Aktivisten gezielt mit Hasskommentaren und einschüchternden Posts „zuzuknallen“, wie sie das selbst nennen würden. Am Ende unserer Auswertung sind wir zu dem Ergebnis gekommen, dass über 50 Prozent der Likes bei Hasskommentaren von nur 5 Prozent der Nutzer ausgehen. Das ist leider ganz schön effektiv und daher auch ziemlich erschreckend.

„Um die gegnerische Bubble zu attackieren, werden Accounts aufgebaut, die sich am eher linken Lager orientieren“

Im Grunde muss man dafür den Algorithmus der sozialen Netzwerke austricksen. Wie funktioniert das?

Es gibt verschiedene Möglichkeiten, je nachdem, was man erreichen will. Das eine sind Online-Manipulationskampagnen – oder wie die Trolle sagen würden: Raids.

„Angriffe“, das klingt ziemlich militärisch.

Ja, die Sprache der Trolle ist zum einen vom Militär geprägt. Zum anderen orientiert sie sich an Online-Computerspielen. Raids steht für einen großen Überfall. Das Ziel ist, entweder einen eigenen Hashtag zum Trenden zu bringen oder einen Hashtag, der eher vom linken Lager verwendet wird und der bereits in den Twitter-Trends vorne liegt, zu hijacken, also zu kapern. Damit das gelingt, verabreden die Trolle in ihren Gruppen eine Uhrzeit und veröffentlichen zum selben Zeitpunkt sehr viele Tweets oder Posts unter demselben Hashtag.

Fällt es nicht auf, wenn es immer dieselben wenigen Accounts sind, die den Hass im Netz verbreiten?

Oft nutzen sie Fake-Accounts – die sind zum Teil über Monate hinweg durch Tweets und Follower aufgebaut worden. Es entsteht der Eindruck, als würden sehr viele Menschen etwas unter diesem Hashtag posten oder tweeten, obwohl es sich in Wirklichkeit nur um ein paar wenige technisch versierte Menschen handelt. Bisweilen werden auch gezielt Accounts aufgebaut, die sich am anderen, also dem eher linken Lager orientieren. Zunächst postet oder tweetet die Person, die den Account betreibt, eher unpolitische Inhalte, um dann später unter den verabredeten Hashtags auch die gegnerische Bubble zu attackieren. Das wird als „red pilling“ bezeichnet.

Eine Referenz auf den Film „Matrix“?

Genau. Wer die rote Pille schluckt, dem ist es möglich, die wirkliche Welt zu sehen. Wer die blaue Pille nimmt, schläft weiter. „Red pilling“ ist ein Euphemismus für den Radikalisierungsprozess, den die Trolle bei anderen Menschen hervorrufen wollen. Es geht ihnen auch darum, die Menschen in zwei Lager zu teilen: das eigene und das gegnerische. Niemand soll politisch in der Mitte bleiben.

„In den Foren wird dazu geraten, nach zwei bis drei Tweets den Account zu wechseln – um nicht ‚geshadowbanned‘ zu werden“

Was ist mit den Plattformen selbst? Unternehmen die nichts?

Mittlerweile ist es schon so, dass Facebook und Twitter häufig erkennen, wenn zu viele Accounts von einem User gleichzeitig verwendet werden oder wenn man zu viele Tweets innerhalb von kurzer Zeit veröffentlicht. Im Troll-Jargon wird der Account dann „geshadowbanned“, also quasi gesperrt. Deshalb wird in den Foren auch immer dazu geraten, nach zwei bis drei Tweets den Account zu wechseln, um das zu verhindern.

Nun ist im Januar 2018 ja das Netzwerkdurchsetzungsgesetz, kurz NetzDG, vollständig in Kraft getreten, das soziale Netzwerke dazu verpflichtet, Hassrede konsequenter zu entfernen. Nützt das was?

Das NetzDG lenkt von der eigentlichen Problematik ab. Selbstverständlich ist es auch Teil der Lösung, klare Aufrufe zur Gewalt, gefährliche oder strafrechtlich relevante Inhalte und eindeutige Hassrede zu entfernen. Aber gerade der Begriff „Hassrede“ ist leider nicht besonders gut definiert. Und dann ist es an den sozialen Netzwerken und ihren Mitarbeitern, zu entscheiden, was darunterfällt und was nicht. Die vergangenen Monate haben gezeigt, dass das NetzDG teilweise für Verwirrung sorgt und dass auch einfach satirische Inhalte auf dessen Basis gelöscht wurden. Das NetzDG ist eben eine politische Lösung, die aber nicht dazu führen darf, dass man sich zurücklehnt und sagt: So, das war jetzt unser Beitrag zur Hass- oder Extremismusbekämpfung im Netz. Das wäre wirklich fatal.

Illustration: Raúl Soria

Dieser Text wurde veröffentlicht unter der Lizenz CC-BY-NC-ND-4.0-DE. Die Fotos dürfen nicht verwendet werden.