Slave to the algorithm

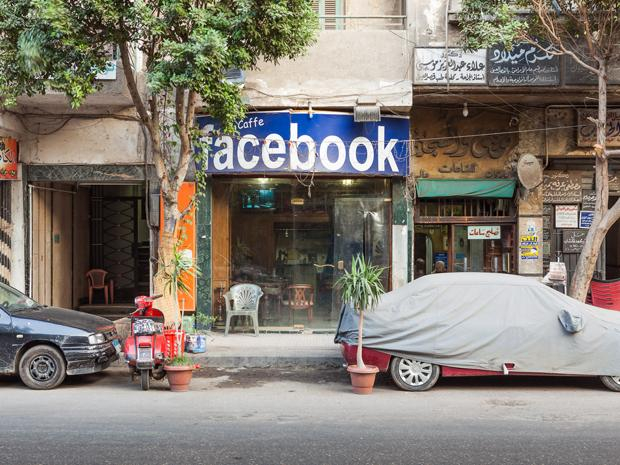

Man kann Facebook auch als eine gigantische Datenfabrik beschreiben, in der Millionen von Usern schuften – sie müssen Rohstoff heranschaffen

Erst mal: Warum eigentlich schenken so viele Menschen den sozialen Netzwerken so freigiebig ihre Daten? Weil ihnen soziale Netzwerke etwas geben, das ihnen im sozialen Nahbereich, etwa im Familienverband, heute oft abhandengekommen ist: Anerkennung, Geltung, Wertschätzung und ein Publikum, vor dem sie sich präsentieren können. Der US-amerikanische Psychologe Abraham Maslow hat diese sozialen Bedürfnisse als grundlegend für den Menschen identifiziert, weshalb sie eine eigene Ebene in dem nach ihm benannten Pyramidenmodell der menschlichen Motivationen bilden. In der globalisierten Gesellschaft aber können die Familie, Freunde und sogar Kollegen sehr weit entfernt sein. Likes unter unseren Fotos helfen uns, das zu verkraften.

Die allgemeine Sehnsucht nach einem mitmenschlichen Resonanzraum

Diese allgemeine Sehnsucht nach einem mitmenschlichen Resonanzraum führt dazu, dass Nutzer auf Facebook täglich 350 Millionen Fotos hochladen, mehr als 60 Milliarden Textnachrichten versenden und mehrere Milliarden Beiträge teilen. Zunächst mal kann der Facebook-Algorithmus daher als die technische Antwort auf das Problem gesehen werden, dass diese Masse von Daten irgendwie strukturiert und selektiert werden muss.

„Algorithmen an sich sind nichts Schlechtes, vielmehr unterstützen sie uns bei Entscheidungsfindungen“

„Algorithmen an sich sind nichts Schlechtes, vielmehr unterstützen sie uns bei Entscheidungsfindungen“, erklärt Katarina Adam, die an der Hochschule für Technik und Wirtschaft Berlin Wirtschaftsingenieurwesen lehrt. Das Prinzip, nach dem der Facebook-Algorithmus für jeden einzelnen Nutzer ständig eine Auswahl trifft, wirkt oberflächlich betrachtet so simpel wie unverdächtig: Drücken wir „Gefällt mir!“ unter einem Artikel, der beispielsweise von einem bestimmten Fußballverein handelt, registriert der Algorithmus diese Interessensbekundung und zeigt uns weitere Artikel über denselben Verein oder verwandte Themen an. Er „vermutet“ dann, dass diese Beiträge uns auch gefallen werden. Und je mehr wir uns durch Likes und Shares betätigen, desto schneller lernt er dazu. Zusätzlich zeigt er uns noch, was unsere Freunde geteilt oder gelikt haben.

Der Algorithmus als unser Freund und Helfer, der uns mit einer persönlichen interessanten Auswahl vor der Datenlawine rettet? Da gibt es Zweifel. Das wohlwollend klingende Motto „Facebook – Eine offene und vernetzte Welt“ kann nicht verschleiern, dass Facebook ein Wirtschaftsunternehmen ist und noch ganz andere Interessen hat. Längst hat es die Wucht des menschlichen Bedürfnisses nach digitaler Interaktion erkannt und versteht es, sie für seine Zwecke zu nutzen.

„Bedenkenswert ist dabei, dass Unternehmen ihren unternehmenseigenen Gesetzen folgen und weniger den Gesetzen, die sich eine Gesellschaft gibt“

Auch Katarina Adam, die den Nutzen von Algorithmen für die Entscheidungsfindung der User betont hat, sieht die Auswertung ihrer digitalen Spuren durch Konzerne wie Facebook kritisch: „Bedenkenswert ist dabei, dass Unternehmen ihren unternehmenseigenen Gesetzen folgen und weniger den Gesetzen, die sich eine Gesellschaft gibt.“ Der Unterschied sei offensichtlich: Eine Gesellschaft entwickle Gesetze, die ihre Moral und Ethik widerspiegeln. Unternehmen hingegen seien auf Gewinnmaximierung ausgerichtet.

In Wirklichkeit hat der Facebook-Algorithmus daher zwei Gesichter – ein sehr nettes und ein sehr neugieriges: Er ist einerseits so gebaut, dass er den Nutzer und seine Interessen bedient – aber auch so, dass er dem Unternehmen möglichst genau zeigt, wer seine Nutzer sind. Denn dieses Wissen ist Gold wert, kann man damit doch Werbetreibenden maßgeschneiderte Anzeigenplätze verkaufen. Durch Werbung hat das Unternehmen im vierten Quartal des Jahres 2016 einen Umsatz von 8,63 Milliarden US-Dollar erwirtschaftet. Der Gewinn im gleichen Zeitraum: 3,6 Milliarden US-Dollar.

Sogar über Nutzer, die sich gerade gar nicht auf der Plattform befinden oder dort nicht mal ein eigenes Profil haben, sammelt Facebook Daten. Es reicht schon, wenn jemand eine Internetseite besucht, die einen Dienst von Facebook nutzt, etwa den blauen Like-Button unter Beiträgen. Durch Cookies und spezielle Code-Schnipsel verfolgt Facebook auch die dortigen Aktivitäten der User.

Weil die Oberfläche von Facebook aus so anschmiegsamen Informationen besteht, die so wunderbar zu den Bedürfnissen der Nutzer passen, ist vielen von ihnen wohl gar nicht bewusst, dass sich das Verhältnis darunter längst umgekehrt hat: Der Algorithmus dient nicht mehr ihnen, sondern sie dem Algorithmus. Sie sind zu unbezahlten Lieferanten von Datenrohstoff geworden, der einigen wenigen Menschen einen unvorstellbaren Reichtum beschert hat. Und diese Datenfabrikanten organisieren ihre Algorithmenfabrik nach Regeln, die nicht wirklich im Interesse der Nutzer liegen können.

Aus wenigen Klicks, Kommentaren und Posts lässt sich ein Persönlichkeitsprofil erstellen

Etwa weil sie die Persönlichkeitsrechte der Nutzer antasten, indem sie sich deren Daten auf oft sehr intransparente Weise beschaffen und zunutze machen. Facebook greift sogar auf die WhatsApp-Daten der Nutzer zu oder räumt sich über Änderungen seiner Nutzungsbedingungen mehr Datensammelrechte ein und stellt die Nutzer schlicht vor die Wahl: Sie können das akzeptieren oder sie sind raus.

Und wie leicht sich schon aufgrund weniger Klicks, Kommentare und Posts ein Persönlichkeitsprofil eines Nutzers erstellen lässt, hat 2008 ein Student der Cambridge University vorgemacht. Er programmierte eine Facebook-App namens MyPersonality, die Nutzern Fragen stellte, die auf dem OCEAN-Modell der Persönlichkeitspsychologie basierten. Die ausgewerteten Antworten wurden mit Facebook-Aktionen der Nutzer abgeglichen und ließen die Schlussfolgerung zu, dass 68 Facebook-Likes eines Nutzers reichten, um mit 95-prozentiger Treffsicherheit dessen Hautfarbe zu ermitteln. Nur zwei Likes mehr, und die App konnte zutreffendere Aussagen über ihn machen als seine Freunde.

Das Wissen, das sich aus den gesammelten Daten über die User generieren lässt, ist nicht nur von wirtschaftlichem Wert, es birgt auch ein ungeheures Machtpotenzial. Was der Philosoph Michel Foucault bereits 1975 über die enge Verbindung von Wissen und Macht gesagt hat, liest sich heute fast wie eine Beschreibung des Facebook-Algorithmus. Foucault hat dargelegt, wie durch neues systematisches Wissen über Individuen ständig neue Möglichkeiten der Kontrolle erwachsen. Und dass durch systematisches Nachfragen immer noch mehr detailliertes Wissen entsteht, wodurch auch die Kontrollmöglichkeiten zunehmen.

Algorithmen reproduzieren immer nur das Weltbild ihrer Designer. Und die verfolgen bestimmte Ziele

Lorena Jaume-Palasí, Dozentin am Lehrstuhl für Philosophie der Ludwig-Maximilians-Universität München und Mitinitiatorin der Beobachtungsplattform Algorithm Watch, betont, dass Algorithmen selbst als Mechanismus dafür nichts können. Sie reproduzieren immer nur das Weltbild ihrer Designer und der die Datenbank definierenden Menschen. Es kommt ganz darauf an, wie man sie nutzt. Ähnlich wie ein Küchenmesser, das dazu verwendet werden kann, Gemüse zu schneiden oder einen Menschen zu bedrohen.

Auch Facebook ist eben keine gesichtslose Fabrik, sondern wird von Menschen gemacht, die in einer bestimmten Weise denken und ihre ganz eigenen Ziele verfolgen. Sie bestimmen, wie Jaume-Palasí betont, nach welchen Regeln man sich als Nutzer auf ihrem Spielfeld bewegt.

Und an diesen Regeln gibt es reichlich Kritik. Sie entzündet sich nicht nur an der kommerziellen Verwertung der persönlichen Daten der Nutzer und der Gefährdung ihrer Privatsphäre. Kritisiert wird auch, dass viele Menschen ihre Timeline mit einem objektiven Nachrichtenkanal verwechseln, anstatt zu sehen, dass es sich dabei um eine hochspezielle Auswahl von Informationen handelt, die zudem immer wieder mal unter Fake-Verdacht stehen – und dass Facebook den Nutzer zu alldem eher im Unklaren lässt und nur recht zögerlich Aufklärungsarbeit leistet.

Längst ist Facebook für Millionen zu einer selbstverständlichen digitalen Ausweitung ihres Lebens geworden. Das Bild der Algorithmenfabrik kann helfen, dass sich mehr Nutzer die dahinterliegenden Mechanismen klarmachen und ihre Facebook-Aktivitäten daraufhin anpassen – oder nach Alternativen zu Facebook suchen.

Tobias Schwarz ist als Editor-at-Large für Netzpiloten.de tätig; von 2013 bis 2016 leitete er Netzpiloten.de. Er schreibt regelmäßig über Fragen des digitalen Wandels und der Transformation der Arbeitswelt.